ZenMux fonctionne comme une plate-forme d’accès qui permet de gérer plusieurs des principaux modèles linguistiques mondiaux à partir d’un centre unique. Les utilisateurs utilisent des modèles développés par différents fournisseurs tels que OpenAI, Anthropic, Google, Alibaba et Baidu via un compte unique et une API commune. Cette structure simplifie les flux de travail des développeurs en éliminant le besoin de basculer entre plusieurs abonnements et différents protocoles. En plus des opérations textuelles sur la plateforme, des outils de production visuelle et vidéo sont également proposés via un panneau de contrôle unique.

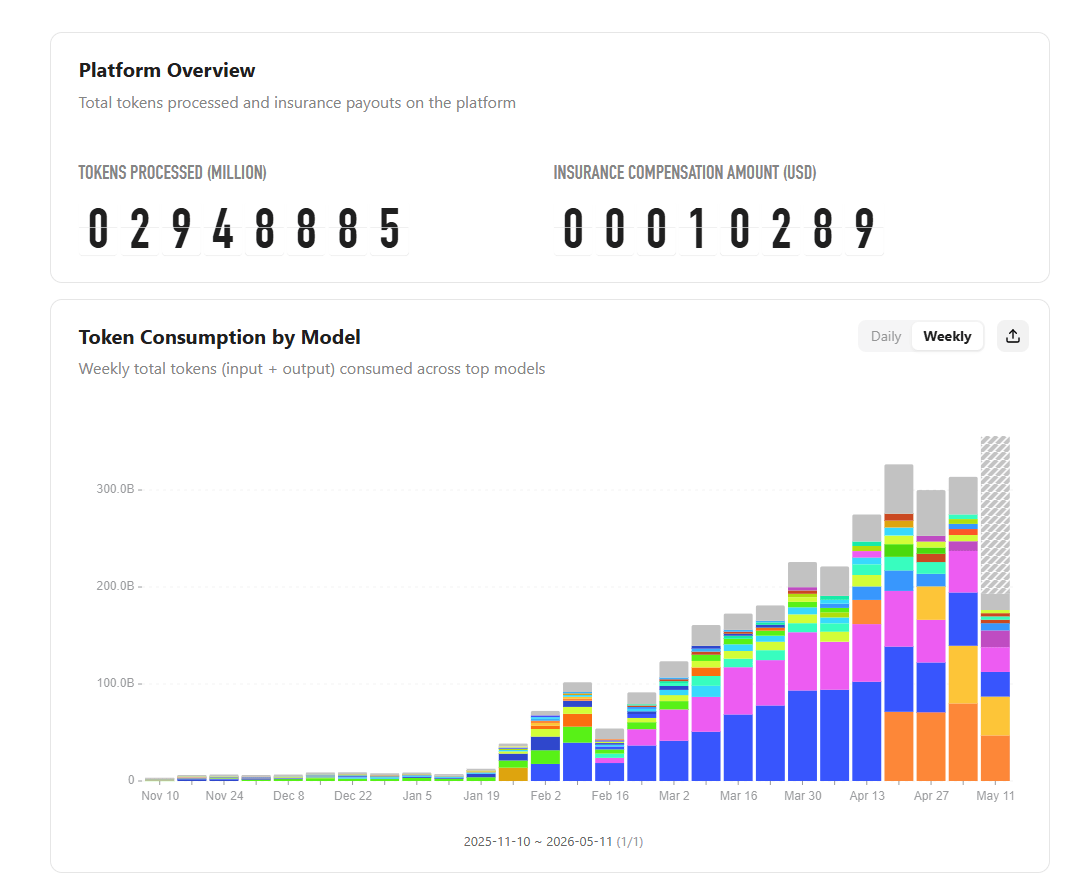

La plateforme, dotée d’une infrastructure orientée développeur, fonctionne en totale conformité avec les protocoles OpenAI et Anthropic. Les utilisateurs utilisent des modèles originaux directement auprès de fournisseurs officiels au lieu de systèmes intermédiaires ou de copies peu performantes. Le système d’assurance automatique, l’une des caractéristiques notables de la plateforme, verse automatiquement une indemnisation à l’utilisateur en cas d’hallucinations ou de latence élevée dans les sorties de l’intelligence artificielle. Ces cas marqués comme incorrects sont ensuite anonymisés et transmis à l’utilisateur sous forme de données de feedback. De cette manière, les utilisateurs obtiennent des ensembles de données précieux pour améliorer leurs propres produits d’intelligence artificielle.

La technologie ZenMux Auto au sein de la plateforme analyse chaque commande arrivant au système et sélectionne le modèle le plus approprié en termes de performances et d’équilibre des prix en quelques secondes. Le système, qui fonctionne de manière intégrée au réseau périphérique mondial Cloudflare, augmente la vitesse des transactions en dirigeant les demandes des utilisateurs vers le centre de données le plus proche. Le mécanisme de sauvegarde multi-fournisseurs du système transfère instantanément le trafic vers des canaux alternatifs lorsqu’un fournisseur modèle subit une panne ou un dépassement de limite. De plus, grâce aux outils analytiques complets proposés, les détails du coût et de l’utilisation de chaque jeton sont surveillés instantanément.

La politique de tarification est déterminée par le modèle préféré et le montant total de pièces traitées. Bien que les frais d’entrée par million de pièces pour Google Gemini 3.1 Flash Lite soient de 0,25 $, les coûts varient pour les modèles haute capacité tels que OpenAI GPT-5.5. La plateforme facture des frais de service standard de 5 %, mais ce taux tombe à 0 % avec des campagnes périodiques.

Bir yanıt yazın